Em 2002, no cinema lançava o filme Minority Report (com Tom Cruise como protagonista), cuja trama se passa em 2054, que para evitar crimes graves aplica-se um métodopara prevê-los antes mesmo de ocorressem. Dentre as estratégias, o uso do reconhecimento biométrico, algo que já não é tão futurista assim, sendo muito utilizado hoje para autenticar o acesso a conta bancária ou entrar em um prédio apenas mostrando o rosto para uma tela.

Um estudo da Serasa Experian apontou que a biometria facial evitou um rombo de R$ 29 bilhões. De 42,1 milhões de consultas biométricas, entre outubro de 2022 a março deste ano, 13,4% teriam alta probabilidade de serem operações fraudulentas.

Biometria

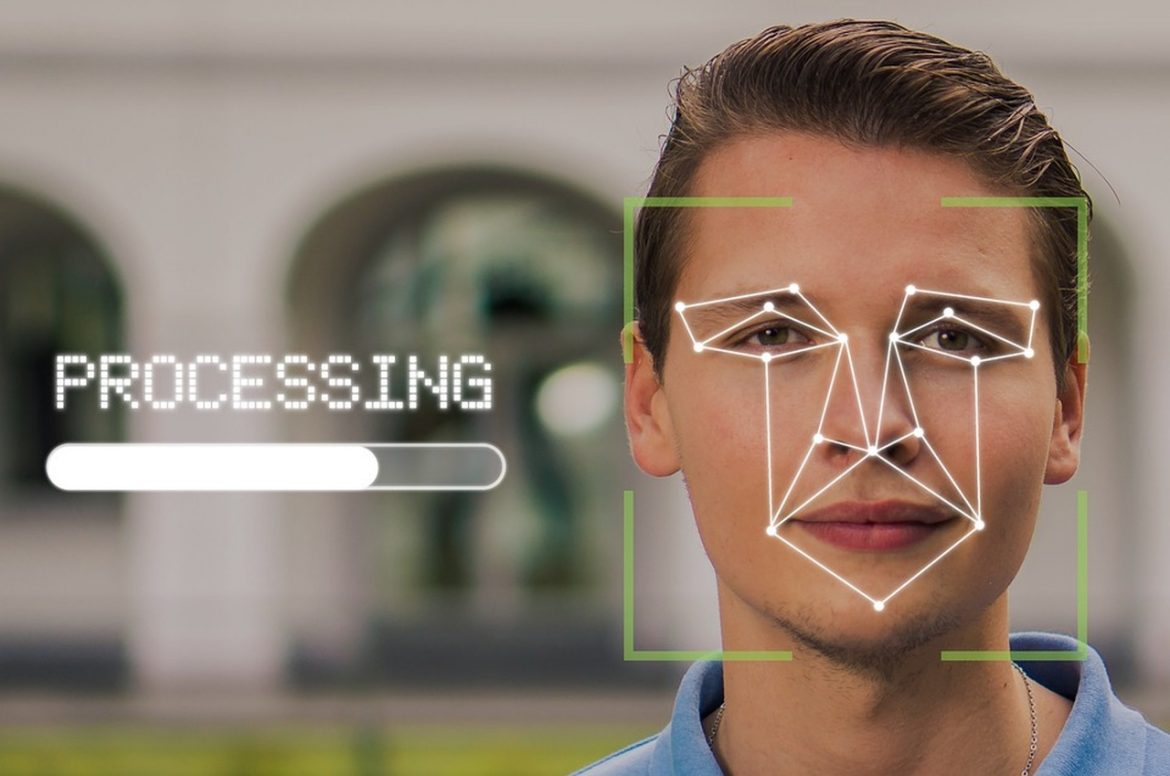

Mas, o que é a biometria, que de acordo com a mesma pesquisa, 93% dos ouvidos se sentem confiáveis? Trata-se de um mapeamento por meio de redes neurais e inteligência computacional, que matematicamente identifica características do rosto de uma pessoa, uma impressão facial. Apesar de moderno, o sistema é bem antigo, tem mais de 50 anos. Os primeiros experimentos foram entre 1964 e 1966, quando o professor Woodrow W. Bledsoe e sua equipe fizeram um experimento de verificação se “computadores de programação” podiam reconhecer rostos humanos, por meio de caraterísticas como olhos e nariz.

Para Daniel Marques, presidente da Associação Brasileira de Lawtechs e Legaltechs (AB2L), esse conceito deve ser utilizado de maneira muito especial e como exceção. “No caso específico de por instituições financeiras, há uma série de benefícios em relação à segurança e prevenção de fraudes. Algoritmos de aprendizado de máquina podem analisar grandes volumes de dados e identificar anomalias que podem indicar atividades fraudulentas, como transações não autorizadas, uso indevido de informações de identificação pessoal e roubo de identidade. Através da biometria facial, há uma autenticação mais segura, com a análise de características únicas do rosto humano”, disse ao Jornal de Brasília.

Deepfake

Como dito por Daniel Marques, o reconhecimento facial é uma realidade que bem aplicada pode trazer benefícios, contudo, especialistas alertam para confusões que essa tecnologia pode causar, como confundir gêmeos idênticos e reconhecer avatares falsos durante a autenticação.

O mesmo relatório da Serasa Experian apontou que a cada 100 tentativas de golpe em 2022, ao menos cinco usaram o recurso de máscaras, vídeos e deepfake, que nada mais é que a Inteligência Artificial combinar imagens e sons já existentes. Cibercriminosos resgatam nas redes sociais as já tradicionais selfies, áudios e juntamente com dados pessoais “montam” um avatar fake, tornando o sistema de reconhecimento facial vulnerável a possíveis fraudes. “Para lidar com esse desafio, os sistemas de biometria facial geralmente são projetados para levar em consideração outros fatores além das características faciais, incluindo a análise de múltiplos pontos de referência no rosto, até mesmo movimentos oculares. Além de solicitar ações como piscar os olhos ou fazer uma expressão específica. Outra abordagem é a autenticação em dois ou mais fatores, onde o reconhecimento facial é uma das etapas, sendo completada por meio do envio de códigos para o celular ou e-mail”, frisou Marques ao Jornal.

Polêmicas

É sabido que o sistema foi útil na prisão de criminosos procurados pela Justiça, mas a grande preocupação é a probabilidade de preconceito racial, apontam especialistas. A Rede de Observatório da Segurança em 2019 apontou que 90% dos presos por meio do reconhecimento facial aqui eram pessoas pretas. Em entrevista à rede CUT, a pesquisadora Brenda Cunha explica que o sistema é falho por ser uma tecnologia com percentual de taxas de erros de identificação maior em pessoas negras, em especial mulheres. “Essas falhas, no contexto da segurança pública, tenderiam a agravar ainda mais o histórico de violência policial existente no país, que tem como alvo principal a juventude negra e periférica”, alerta.

“Tecnologias de IA como a utilizada por bancos em verificações de segurança também são encontradas em aplicativos de fotos, mídias sociais e até mesmo sistemas de segurança pública. Os algoritmos utilizados nessas ferramentas, por sua vez, comprovam-se bem falhos”, acrescenta Renan Nunes, do Money Times.

Outra questão é sobre a privacidade, já que a implantação do sistema ocorre, como visto, apenas online, mas nas ruas e também estabelecimento, como os de ensino. Clarice Tavares, coordenadora da área de Desigualdades e Identidades do InternetLab, à Agência Brasil, informa que as empresas que oferecem o serviço às escolas devem trabalhar a partir de estereótipos. “É um pouco difícil não pensar que isso não esteja associado a essa predição sobre quem tem mais tendência a ser reprovado na escola ou cometerem atos que reprovam na escola a questões mais estruturais, como raça, classe e gênero. Como essas tecnologias são construídas também para prever possíveis ações, isso é um pouco preocupante, principalmente quando se fala em crianças e adolescentes, que são populações que precisam ser mais protegidas ainda”, frisa.

De um ponto, todos concordam. A tecnologia por biometria já é uma realidade que não terá mais volta, contudo, ela não dissolverá um fator importante: o ser humano para repensar suas decisões.

Foto: Reprodução